AIを悪用したサイバー攻撃とは?最新の手口・被害事例・企業の防御戦略を徹底解説

- AIを悪用したサイバー攻撃の最新手口と被害事例

- 防御側がAIを活用しなければならない理由と具体的な対策ロードマップ

- 自社のセキュリティ対策を前に進めるための優先順位と専門家活用の考え方

「AIを活用しよう」という号令が社内に広がるなか、攻撃側も同じAIを武器にしているとしたら——。その不安は、残念ながら正しいと言えます。

IPA「情報セキュリティ10大脅威2026」ではAI関連リスクが初選出で3位に浮上し、侵入から横展開までの時間は平均29分にまで縮みました。

本記事では、最新の攻撃手口・被害事例から防御の思想、企業が今すぐ取るべき対策までを体系的に解説します。

AIがサイバー攻撃を変えた—なぜ今が転換点なのか

AIが攻撃に本格的に活用された結果、サイバー脅威の「質・量・速度」のすべてが変わりつつあります。ここでは最新データをもとに、企業が今まさに直面している脅威の規模を整理します。

IPA「情報セキュリティ10大脅威2026」—AIリスクが初選出3位の意味

2026年1月、独立行政法人情報処理推進機構(IPA)は「情報セキュリティ10大脅威2026」を公表しました。組織向けランキングにおいて、「AIの利用をめぐるサイバーリスク」が初めて選出され、3位にランクインしています。※出典:IPA「情報セキュリティ10大脅威2026」

このランキングは、2025年に発生した情報セキュリティ事案のうち社会的影響の大きかったものをIPAが候補として選定し、情報セキュリティ分野の研究者や企業の実務担当者など約250名で構成される「10大脅威選考会」が審議・投票を経て決定したものです。

注目すべきは、11年連続選出で6年連続1位の「ランサム攻撃による被害」、4年連続2位の「サプライチェーンや委託先を狙った攻撃」と並ぶ形で、AI関連リスクが初選出にもかかわらず3位という高い順位で登場した点です。IPAによれば、このリスクは「AIに対する不十分な理解に起因する意図しない情報漏えいや他者の権利侵害」「AIの加工・生成した結果を検証せず鵜呑みにすることで生じる問題」「AIの悪用によるサイバー攻撃の容易化・手口の巧妙化」など、多岐にわたるとされています。

以下は「情報セキュリティ10大脅威2026」組織向けランキングの一覧です。

図表1:IPA 情報セキュリティ10大脅威2026 ランキング表

| 順位 | 脅威名 | 前年順位 | AI関連ポイント(JBCCによる整理) |

|---|---|---|---|

|

1位 |

ランサム攻撃による被害 | 1位 |

AIが攻撃を自動化。侵入後の横展開が平均29分に短縮。 |

| 2位 | サプライチェーンや委託先を狙った攻撃 | 2位 |

AIが脆弱な委託先を自動探索し、踏み台攻撃が高度化。 |

| 3位 ★ | AIの利用をめぐるサイバーリスク | 初選出 | 生成AI悪用・シャドーAI等、AI固有のリスクが顕在化。 |

| 4位 | システムの脆弱性を悪用した攻撃 | 3位 |

AIが未知の脆弱性を高速スキャンし、攻撃コードを即座に生成。 |

| 5位 | 機密情報を狙った標的型攻撃 | 5位 | 生成AIが精巧な日本語メールを生成。なりすまし精度が急上昇。 |

| 6位 | 地政学的リスクに起因するサイバー攻撃(情報戦を含む) | 7位 | 国家支援の攻撃者がAIエージェントを活用し、APTを展開。 |

| 7位 | 内部不正による情報漏えい等 | 4位 | シャドーAIによる意図しない機密情報漏えいリスクが増大。 |

| 8位 | リモートワーク等の環境や仕組みを狙った攻撃 | 6位 | AIフィッシングで認証情報を騙し取る攻撃が高度化。 |

| 9位 | DDoS攻撃(分散型サービス妨害攻撃) | 8位 |

AIによるボットネット制御で攻撃の規模・巧妙さが増大。 |

| 10位 | ビジネスメール詐欺 | 9位 |

生成AIで人物・文体を精巧に模倣した偽メールが量産化。 |

つまり、AIをめぐるリスクはすべての組織にとって対策が求められるフェーズに入っています。

なお、JBCCブログでは、IPA 10大脅威2026の全体像と「AIの利用をめぐるサイバーリスク」に対する対策の考え方を別記事で解説しています。あわせてご覧ください。

▶参考:JBCC「【2026年最新】IPA発表『情報セキュリティ10大脅威 2026』初選出『AIの利用をめぐるサイバーリスク』と情報システムが押さえるべき対策」

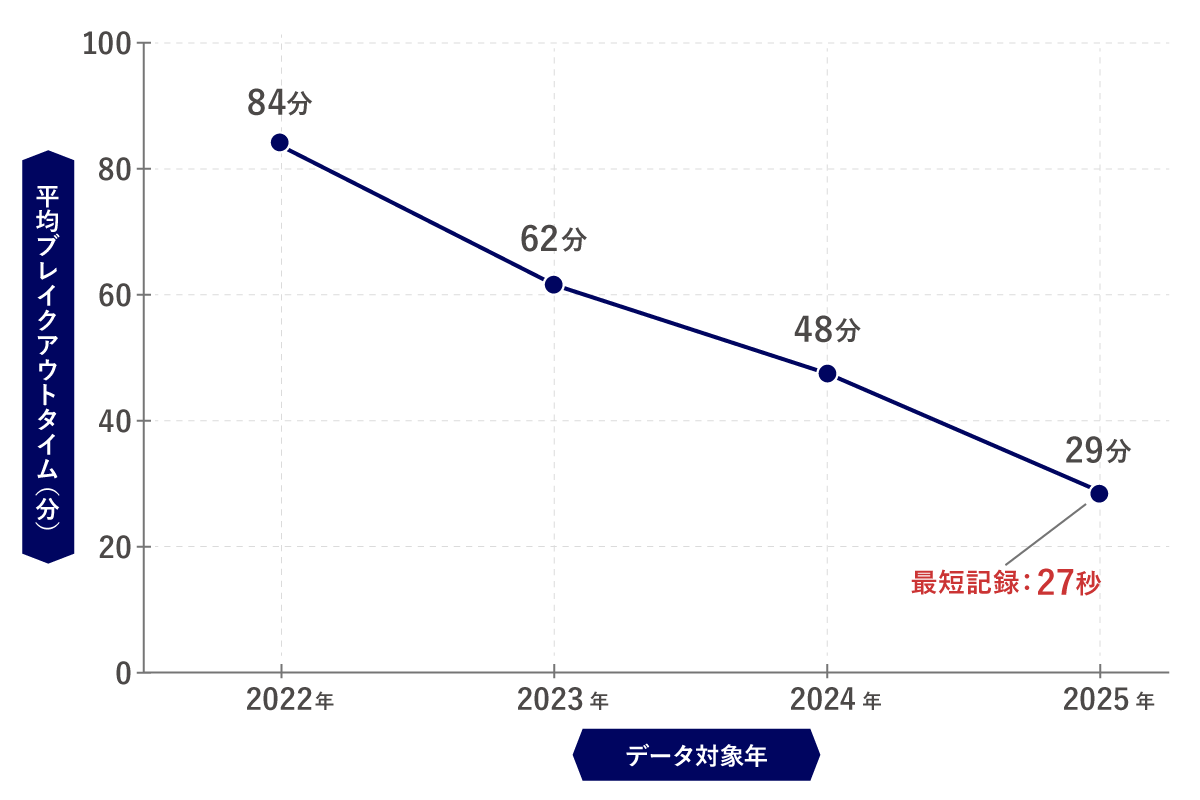

ブレイクアウトタイム平均29分・AIを活用した攻撃活動前年比89%増という現実

攻撃者がAIを活用するようになったことで、サイバー攻撃の「速度」と「量」が、従来とはまったく異なるレベルに達しています。

セキュリティ企業CrowdStrikeが公表した「2026 Global Threat Report」によると、攻撃者がシステムへの初期侵入を果たしてから、ネットワーク内の他のシステムへ横展開を開始するまでの時間(ブレイクアウトタイム)は、平均29分にまで短縮されています。最短のケースではわずか27秒です。

この数字が意味するのは、従来のように「アラートを検知し、ログを確認し、初動対応を行う。重要度に応じてチームを招集し、対応方針を決める」というプロセスでは、間に合わない可能性があるということです。一般的な企業環境では、ネットワーク監視の間隔は1分または5分が実務上の目安とされており、Amazon EC2のCloudWatchも基本モニタリングは5分間隔、詳細モニタリングを有効にすると1分間隔となります。最短27秒・平均29分というブレイクアウトタイムに対し、人間がアラートに気づき、状況を把握する時間そのものが、攻撃の横展開よりも遅くなっているのが現状です。

さらに、AIを積極的に活用する攻撃者の活動は前年比で89%増加しています。これは攻撃試行数の全体ではなく、AIを積極的に活用していると判断された攻撃者グループに限定した数値です。攻撃の自動化・効率化が進んだ結果、1つの攻撃グループが同時に複数のターゲットを並行して攻撃することが可能になっており、量の面でも防御側の処理能力を超えつつあります。

攻撃の高速化は他社レポートでも同様の傾向が示されています。パロアルトネットワークス社のホワイトペーパー「The 25 Minute Ransomware Attack」では、現代のランサムウェア攻撃はわずか25分で完了すると指摘されており、速度面の課題は業界横断の共通認識となっています。

図表2:ブレイクアウトタイム短縮の推移(2022〜2025年)

※出典:CrowdStrike Global Threat Report(各年版)より作成。横軸はデータ対象年。

速度と量の両面で防御側の許容範囲を超え始めている——これが、AIがサイバー攻撃を「転換点」に押し上げた最大の理由です。

AIを悪用した主な攻撃手口と被害事例

高度な技術力を持たない攻撃者であっても、生成AIを使えばプロ級の攻撃を実行できる——そうした環境が整ったことで、攻撃の種類・精度・規模のすべてが変わりました。以下の図は、攻撃フェーズごとにどのAI技術が使われ、どのような被害につながるかを整理したものです。ここからは、代表的な攻撃手口をメカニズムと被害事例のセットで解説していきます。

図表3:AIを悪用した攻撃の全体フロー(攻撃フェーズ × AI活用マップ)

| 攻撃フェーズ | ① 情報収集 | ② 標的化 | ③ 侵入 |

④ 横展開 |

⑤ 実害 |

|---|---|---|---|---|---|

|

使われるAI技術 |

OSINT自動化 SNS解析AI |

生成AI ディープフェイク |

脆弱性スキャンAI 自動エクスプロイト |

AIエージェント (自律動作) |

ランサムウェア 自動展開AI |

|

主な攻撃内容 |

組織情報・メールアドレスの大量収集 | 完璧な日本語のフィッシング・ニセ社長詐欺 |

マルウェア自動生成 ゼロデイ脆弱性悪用 |

権限昇格・横展開 (平均29分で完了) |

暗号化・身代金要求 機密情報の売却 |

高度化したフィッシング・BEC—完璧な日本語で人を欺くソーシャルエンジニアリング

「不自然な日本語で書かれているから見破れる」——フィッシングメールに対するこの従来の常識は、すでに通用しなくなりつつあります。

生成AIは、標的となる組織の業界用語や社内文書の文体を学習し、受信者が疑念を持たないレベルのメッセージを自動生成します。ハーバード大学ケネディスクールの学術論文(Heiding et al., 2024)では、AI生成フィッシングメールのクリック率が従来の手法と比較して約4.5倍となる54%に達したと報告されています。

国内でもフィッシング被害は急拡大しています。フィッシング対策協議会「フィッシングレポート2025」によれば、2024年のフィッシング報告件数は171万件を超え、過去最多を更新しました。

さらに、ビジネスメール詐欺(BEC)においても同様の変化が起きています。経営者や取引先の文体を模倣したメールが精巧に作られ、担当者が真偽を判断するのは極めて困難です。IPA「情報セキュリティ10大脅威2026」でも10位に「ビジネスメール詐欺」がランクインしています。IPAが公開している事例では、業種や規模のみが記載された匿名事例として、AI生成が疑われるフィッシングメールによる被害が複数報告されています。

ディープフェイク詐欺—5ドルで作れる「偽役員の音声・動画」が企業を揺るがす

テキストだけでなく、音声や映像を使ったなりすましも急速に現実化しています。

McAfee社の調査「State of the Scamiverse」によると、ディープフェイクの音声・動画はわずか5ドル・10分程度で作成可能な状態にまで到達しています。

この低コスト化により、CFOや経営者を装った緊急送金指示(いわゆる「ニセ社長詐欺」)が急増しています。ビデオ通話で本人確認したつもりが、実はAIが生成したリアルタイムの映像だったというケースも海外では報告されています。音声や動画を「本人の証拠」とみなす従来の前提そのものが揺らいでいる状況です。

マルウェア自動生成・脆弱性の自動エクスプロイトと被害事例

攻撃ツールの作成においても、AIの影響は顕著です。

生成AIを利用すれば、プログラミングの専門知識がなくても、特定の環境に最適化されたカスタムマルウェアを短時間で生成できます。さらに、AIが対象システムの脆弱性を高速でスキャンし、見つかった脆弱性に対する攻撃コードを即座に生成・実行する——こうした一連の工程が自律化されつつあります。

従来であれば高度なスキルを持つ攻撃者にしかできなかった作業が、AIの支援により広範な攻撃者層に開放されました。攻撃の「裾野」が広がった結果、これまでターゲットになりにくかった中堅企業にも被害が及ぶリスクが高まっています。「うちのような規模の会社は狙われない」という前提は、もはや成り立ちません。

AIエージェントによる「自律型攻撃」—約30組織への侵入を自律的に試み、一部に成功した事例

ここまで紹介した攻撃手口は、いずれも「人間が指示を出し、AIがそれを実行する」というモデルでした。しかし2026年、その前提を覆す事例が報告されています。

Anthropic社の脅威インテリジェンスチームが2025年9月に検知し、同年11月に公表した調査報告によれば、中国のハッカーグループが同社のAIコーディングツールを悪用し、Agentic AI(エージェント型AI)として攻撃工程の80〜90%を自律的に実行させていました。人間の攻撃者が標的を選定し戦略的な指示を与えた後は、AIが偵察から脆弱性発見、攻撃コード生成、横展開、データ抽出までを自律的に実行。失敗すれば自ら戦術を修正して再試行し、約30の組織への侵入を試みて一部への侵入に成功しています。

この事例は、業界の予測とも符合しています。トレンドマイクロが2025年12月に公表した「法人セキュリティ脅威予測2026」では、2026年にはサイバー攻撃に特化したAIエージェントが偵察から初期侵入、ランサムウェア実行・脅迫までの一連の攻撃を自律的に実行する可能性が指摘されています。Anthropic社が報告した事例は、こうした予測を裏付ける最初期の実例と位置付けられます。

※出典:トレンドマイクロ「法人セキュリティ脅威予測2026」

「攻撃の自動化」から「攻撃の自律化」へ——この変化は、防御側が対処すべき脅威の質そのものを変えるものです。24時間365日休むことなく攻撃を続けるAIエージェントに対して、人間の監視体制だけで対抗することの限界がここにあります。

AIシステム固有の攻撃ベクトル—プロンプトインジェクション・データポイズニング等

AIを悪用した攻撃だけでなく、AIシステムそのものを標的にした攻撃も2026年の重要課題として浮上しています。

代表的な手口として、AIに不正な指示を埋め込んで意図しない動作を引き起こす「プロンプトインジェクション」、学習データに悪意あるデータを混入させてモデルの判断を歪める「データポイズニング」、モデル自体を複製する「モデル抽出攻撃」、そしてAI関連のソフトウェアパッケージに偽装した悪意あるコードを配布する「タイポスクワッティング」などが挙げられます。これらはOWASP「Top 10 for LLM Applications」でも整理されている攻撃類型です。

図表4:LLM固有の主な攻撃ベクトル一覧

| 攻撃手法 | メカニズム | 企業リスク |

|---|---|---|

|

プロンプトインジェクション OWASP LLM01 |

AIへの入力文に不正な指示を埋め込み、本来の制御を迂回させる手法。直接入力する方法と、外部コンテンツ(Webページ・文書等)に指示を仕込む間接型がある。 | 機密情報の漏えい、AIによる不正操作の実行、社内システムへの不正アクセスの足がかり |

|

データ・モデルポイズニング OWASP LLM04 |

学習データやファインチューニング用データに悪意あるデータを混入させ、モデルの判断や出力を攻撃者の意図する方向に歪める。 | AIの判断精度の低下、バックドアの埋め込みによる長期的な情報窃取、意思決定の誤誘導 |

|

サプライチェーン攻撃(タイポスクワッティング含む) OWASP LLM03 |

AI関連のライブラリやモデルの配布経路を悪用。正規パッケージに酷似した名称の悪意あるコード(タイポスクワッティング)や、改ざんされた学習済みモデルを配布する。 |

開発環境への侵入、マルウェアの社内展開、知的財産の流出 |

|

機密情報の開示 OWASP LLM02 |

プロンプトの工夫やモデルの挙動分析を通じて、学習データに含まれる個人情報・機密データ・システム構成情報等をAIに出力させる。 | 個人情報・営業秘密の漏えい、コンプライアンス違反、訴訟リスク |

|

過度のエージェンシー OWASP LLM06 |

AIエージェントに過剰な権限(ファイル操作・DB接続・外部API呼び出し等)を付与した状態で運用し、意図しない操作やデータ変更が実行される。 |

データの誤削除・改変、外部への意図しない情報送信、業務システムの誤動作 |

|

システムプロンプト漏えい OWASP LLM07 |

攻撃者がAIの応答パターンを分析し、システムプロンプト(AIの動作ルール・制約条件)を推測・抽出する。 | セキュリティポリシーの露出、AIの制御回避手法の特定、二次攻撃への悪用 |

※出典:OWASP「Top 10 for Large Language Model Applications 2025」(owasp.org)をもとに、本記事の文脈に沿って主要6項目を抜粋・整理。

社内で生成AIを導入・運用している組織にとっては、AIが「攻撃の道具」になるだけでなく「攻撃の対象」にもなりうることを認識しておく必要があります。

シャドーAI・クラウド環境固有のリスク—IPA7位「内部不正」の実態

ここまでは外部からの攻撃を中心に見てきましたが、組織内部にも見過ごせないリスクがあります。

生成AIの業務活用が広がるにつれ、情報システム部門の承認を得ないまま従業員が利用するAIツール——いわゆる「シャドー AI」が増加しています。問題は悪意の有無ではありません。業務効率化のために善意で使ったAIツールに、意図せず社内の機密情報が入力され、外部へ漏えいしてしまうケースが現実に起きています。

IPA「情報セキュリティ10大脅威2026」で7位にランクインした「内部不正による情報漏えい等」の背景にも、こうしたシャドー AIの問題があります。加えて、SaaS・IaaS環境の設定ミスや、自律的に動作するAIエージェントへの権限付与の甘さも、攻撃者にとっての侵入口となりえます。

外部からの攻撃対策と同時に、AIの社内利用に関する可視化とルール整備を進めることが急務です。

「AI vs AI」—なぜ防御側もAIなしでは追いつけないのか

前章で見てきたように、攻撃の質・量・速度は人間の対応力を超えつつあります。ここでは、防御側がAIを取り入れなければならない理由と、2026年の防御戦略の根幹となる思想・原則を整理します。

図表5:攻撃側 AI vs 防御側 AI 対比図

| 攻撃側AI(Offense) | vs | 防御側AI(Defense) |

|---|---|---|

| フィッシング・BECメールの自動生成(生成AI) | vs | AIOps・SOC自動化(リアルタイム異常検知・自動遮断) |

| ディープフェイク音声・動画によるなりすまし | vs | Preemptive Cybersecurity(攻撃前に修復する予測型防御) |

| マルウェア・エクスプロイトの自動生成 | vs | ガードレール(AI利用の可視化と制御) |

| AIエージェントによる自律侵入(80〜90%自動化) | vs | NHI管理・ゼロトラスト(最小権限の原則) |

| プロンプトインジェクション・データポイズニング | vs |

AI-EDR・エンドポイント異常検知 |

ガートナーが提唱する「予測型防御(Preemptive Cybersecurity)」—攻撃の前に修復する

「攻撃を検知してから対応する」という従来の防御モデルは、攻撃速度がここまで上がった今、構造的な限界を迎えています。

この課題に対してガートナーが提唱しているのが「予測型防御(Preemptive Cybersecurity)」という考え方です。ガートナーは「Top Strategic Technology Trends 2026」の全10大トレンドの一つにこのアプローチを位置づけ、「予測こそが防御である(Prediction is protection)」と表現しています。

予測型防御の本質は、AIによる予測的脅威インテリジェンス、高度なデセプション技術(攻撃者を偽の環境に誘導して情報を収集する手法)、自動化されたムービングターゲットディフェンス(防御対象の構成を動的に変化させる手法)などを組み合わせることで、攻撃が実行される前に脅威を無力化する点にあります。

ガートナーは2030年までに、予測型防御ソリューションがセキュリティ支出全体の半分を占めるようになると予測しています。これは防御の基本思想そのものが「検知→対応」から「予測→先制」へ移行しつつあることを示しています。

AIOpsとSOC自動化—アラート疲れを解消し「防御の穴」を塞ぐ原則

多くの企業のセキュリティオペレーションセンター(SOC)が抱える最大の弱点は、膨大なアラートによる「アラート疲れ」です。

セキュリティ製品が検知するアラートの数は年々増加し、その大半は誤検知や低優先度の通知です。結果として、本当に対応すべき重大なアラートが埋もれ、対応が遅れるという構造的な問題が生じています。前章で述べた攻撃側のスピードを踏まえると、この遅延は致命的です。

AIOpsの考え方は、この問題に対する原則的な回答です。AIがログをリアルタイムで分析・相関付けし、ノイズを自動フィルタリングすることで、人間のアナリストは本当に高度な判断が必要なインシデントのみに集中できるようになります。セキュリティ企業UnderDefenseの調査では、AI活用により15分でのインシデント封じ込め(MTTC)を実現した事例※が報告されています。(※同社自社SLAに基づく自己申告値)

重要なのは、AIが人間の仕事を「置き換える」のではなく、「人間が判断すべき事案を絞り込む」という分業の原則です。AIは大量のデータ処理と初動対応を担い、人間は文脈を踏まえた高度な意思決定に専念する——この役割分担こそが、AI時代のSOC運用の基本設計となります。

「ガードレール」の思想—AIを止めずに守るという発想

防御にAIを活用する一方で、社内で利用するAIそのものを守る仕組みも不可欠です。

前章で述べたとおり、プロンプトインジェクションやデータポイズニングなど、AIシステムを標的にした攻撃が現実化しています。つまり、AIは「防御のための武器」であると同時に「防御すべき対象」でもあるのです。

この両面性に対応する考え方が「ガードレール」です。ガードレールとは、AIの利用を禁止するのではなく、安全に活用するための枠組みを設けるという発想を指します。どのAIがどのようなデータにアクセスしているかを可視化し、不正な動作や意図しないデータ漏えいを検知・遮断できる状態を維持する——この「止めずに守る」という思想が、AI活用とセキュリティを両立させる鍵となります。

企業が今すぐ取るべき対策—専門家との連携が鍵

脅威の実態と防御の思想を整理してきました。ここからは、企業がAIによる攻撃に対抗するために着手すべき対策を、組織的対策・技術的対策・専門家との連携という3つの軸で解説します。すべてを同時に進める必要はありません。自社の現状に照らし合わせ、優先順位をつけて取り組むことが重要です。

AIガバナンス体制の構築—経産省・総務省ガイドライン準拠のポリシー策定

技術的な対策を導入する前に、まず整えるべきなのが「社内でAIをどう使うか」のルールです。

2025年3月、経済産業省と総務省は「AI事業者ガイドライン(第1.1版)」を公表しました。このガイドラインは、AI開発者・提供者・利用者それぞれが取り組むべき事項を整理した非拘束的なソフトローであり、企業が社内AIポリシーを策定する際の実質的な拠り所となるものです。

情報システム部門が特に押さえるべきポイントは、AIの利用範囲と禁止事項の明文化、機密情報の入力制限ルール、そしてインシデント発生時の報告フローの3点です。ルールは作るだけでなく、従業員が実際に遵守できるレベルの具体性を持たせることが成否を分けます。

ゼロトラストへの移行と非人間アイデンティティ(NHI)管理の実装

ネットワークの内側を信頼する従来型の境界防御モデルは、クラウド活用やリモートワークの普及によって前提が崩れています。すべてのアクセスを検証対象とするゼロトラストネットワークアクセス(ZTNA)への移行が、多くの企業にとって喫緊の課題です。

さらにAI時代特有の課題として浮上しているのが、NHI(Non-Human Identity:非人間アイデンティティ)の管理です。自律的に動作するAIエージェントやAPIキー、サービスアカウントなど、「人間ではない主体」によるアクセスが急増しており、これらにも最小権限の原則を適用する必要があります。ガートナーは「Top Cybersecurity Trends for 2026」のTrend 4として、ID管理がAIエージェントに適応する必要性を指摘しています。

多要素認証(MFA)・AI-EDRによるエンドポイント強化

ゼロトラストの考え方を実現する上で、最も優先度が高い施策の一つがMFA(多要素認証)の全社展開です。

前章で述べたとおり、AIフィッシングは従来の手法と比較して格段に精巧です。パスワードだけに頼る認証は突破されるリスクが極めて高く、MFAの導入は「コストの許す範囲で」ではなく「優先的に」進めるべき対策です。

あわせて、AI-EDR(AI搭載型Endpoint Detection and Response)の導入も検討が必要です。従来のウイルス対策ソフトがパターンマッチングに依存していたのに対し、AI-EDRはエンドポイントの挙動をリアルタイムで分析し、未知のマルウェアや不審な振る舞いを検知します。攻撃の横展開が数十分で完了する現在、「検知してから人間が判断する」だけでなく「検知と同時に自動遮断する」仕組みが不可欠です。

従業員教育と疑似攻撃演習(フィッシングシミュレーション)の継続実施

技術的な対策がどれだけ整っていても、最終的にメールを開き、リンクをクリックするのは人間です。

AIフィッシングが高度化した現在、年1回の集合研修やeラーニングだけでは不十分です。効果的なのは、疑似フィッシングメールを定期的に送信し、従業員が実際の業務環境の中で「怪しさに気づく力」を鍛える実践型の訓練です。

もう一つ重要なのは、「不審なメールを受け取ったらすぐ報告する」という文化の醸成です。報告した従業員を責めるのではなく、報告そのものを奨励する仕組みがあってこそ、組織全体のセキュリティレベルが底上げされます。技術と人の両輪で守る体制を築くことが、AI時代のフィッシング対策の基本です。

インシデント発生後の対応体制(IRプラン・BCP)—万一に備えた準備

ここまで述べてきた対策を講じたとしても、攻撃を完全に防ぐことは不可能です。重要なのは、侵害が発生した場合に被害を最小限に抑え、事業を継続できる体制をあらかじめ整えておくことです。

具体的には、インシデントレスポンスプラン(IRプラン)の策定が出発点となります。「誰が」「何を」「どの順序で」対応するかを事前に文書化し、定期的な訓練を通じて実効性を確認しておくことが不可欠です。さらに、IRプランと事業継続計画(BCP)を連携させることで、サイバー攻撃による業務停止からの復旧シナリオも明確になります。

自社でSOCやCSIRT体制を構築・運用するリソースがない場合は、マネージドSOCへの委託も有効な選択肢です。重要なのは「完璧な体制を目指す」ことではなく、「万一の際に動ける状態にしておく」ことです。

外部の専門家と守る—一人で抱え込まない体制づくり

本記事で解説してきた対策は、いずれも情報システム部門にとって負荷の大きいものです。「必要なのはわかるが、社内にリソースがない」「何から手をつければいいかわからない」という声は、多くの企業で共通しています。

こうした状況では、すべてを自社で抱え込むのではなく、セキュリティ専門企業のリソースを活用するという判断が合理的です。リスクアセスメントによる現状の可視化、SOCによる24時間365日の監視体制、インシデント発生時の原因分析と復旧支援——これらを外部の専門チームと分担することで、情報システム部門は自社の業務環境に即した判断や社内調整に集中できるようになります。

セキュリティ対策を「一人で抱え込む」必要はありません。JBCCもこうした外部支援の体制を提供しています。詳しくは、本記事末尾のご案内をご覧ください。

まとめ—AI時代のサイバー攻撃に備えて今できること

AIによるサイバー攻撃の脅威は、すでに現実のものとなっています。本記事で見てきたとおり、攻撃の速度・規模・自律性は、従来の防御体制では対処しきれない段階に入りました。

一方で、「何から手をつければいいかわからない」という状態のまま立ち止まることが、最大のリスクでもあります。本記事で整理した対策の中から、自社にとって優先度の高いものを一つでも選び、まず着手することが重要です。AIは攻撃のための道具であると同時に、正しく活用すれば最も強力な防御のための武器にもなります。

JBCCグループでは、自社グループ約2,000名規模でゼロトラストセキュリティを実践し、SASE・EDR・CSPM・CASB・ASMによる全方位の防御体制を構築してきました。この実践事例をまとめた資料を公開しています。自社のセキュリティ対策を見直す際の参考として、ぜひご活用ください。

見逃し配信

資料ダウンロード

【"伴走型" ゼロトラスト|セキュリティ自社実践事例】JBCCグループ

ゼロトラストで守るクラウド・AI 時代のセキュリティ

~自社を「実践のショーケース」に、JBCCグループが挑んだ"全方位" 改革~

製品・サービス

JBCCのセキュリティサービス

サプライチェーンを狙うランサムウェア攻撃や、生成AIの業務利用で高まるセキュリティリスク。複雑化する脅威に対し、監視・検知・インシデント対応までを一元的に支援するマネージドセキュリティサービスをご提供します。

詳細を見る企業のIT活用をトータルサービスで全国各地よりサポートします。

JBCC株式会社は、クラウド・セキュリティ・超高速開発を中心に、システムの設計から構築・運用までを一貫して手掛けるITサービス企業です。DXを最速で実現させ、変革を支援するために、技術と熱い想いで、お客様と共に挑みます。